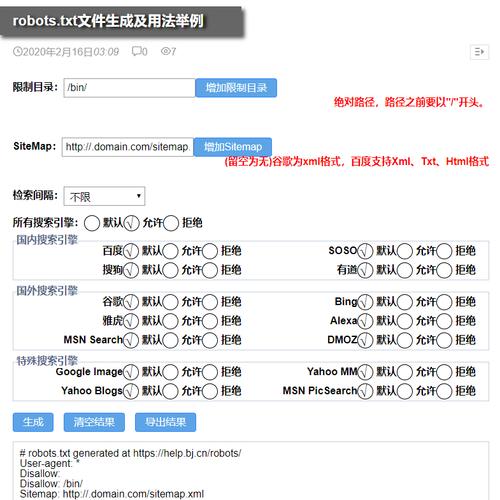

robots.txt 是一个位于网站根目录下的纯文本文件,它告诉搜索引擎的爬虫(Spider)哪些页面可以抓取,哪些页面不可以,合理配置 robots.txt 对于SEO(搜索引擎优化)至关重要。

(图片来源网络,侵删)

robots.txt 的基本语法

在动手配置之前,我们先了解两个核心指令:

-

User-agent: 指定这条规则是针对哪个爬虫的。

- 代表所有爬虫(通用)。

Baiduspider:代表百度爬虫。Googlebot:代表谷歌爬虫。- 通常我们使用 来设置通用规则,再为特定搜索引擎(如百度)设置特定规则。

-

Disallow: 指定不允许爬虫抓取的目录或文件。

- 禁止访问整个网站。

/admin/:禁止访问/admin/目录及其所有子目录。/temp/:禁止访问/temp/目录。Disallow:或Disallow *:表示允许访问所有页面(空指令)。

示例:

(图片来源网络,侵删)

User-agent: *

Disallow: /admin/

Disallow: /data/

Disallow: /templets/

Disallow: /plus/这个示例告诉所有爬虫,不要抓取 admin、data、templets 和 plus 这几个目录。

为什么需要为织梦(DedeCMS)配置 robots.txt?

织梦CMS的目录结构包含一些对用户和搜索引擎都无用的目录,这些目录中的文件可能会被爬虫抓取,造成资源浪费,甚至可能暴露网站的技术架构或安全信息。

需要禁止抓取的织梦典型目录:

/data/:极其重要! 存放网站配置文件(config.php)、缓存、Session等,包含敏感信息,必须禁止。/dede/:后台管理目录,必须禁止。/templets/:存放网站模板文件,抓取这些文件会暴露你的网站结构,没有SEO价值,建议禁止。/plus/:存放一些功能模块文件,如diy.php、feedback.php等,这些页面通常是动态生成的,对SEO帮助不大,且可能被恶意利用,建议禁止。/special/:专题目录,如果专题已经通过首页或其他静态页面收录,可以禁止直接访问专题动态列表页。/include/:存放核心函数库,建议禁止。/install/:安装目录,如果网站已经安装完成,必须禁止。

需要允许抓取的目录:

(图片来源网络,侵删)

- 网站根目录,包含首页和所有生成的静态页面(如

/a/,/jiaocheng/等),必须允许。 /uploads/:上传目录,包含图片、附件等,应该允许,因为图片和附件是网站内容的一部分。

织梦(DedeCMS)robots.txt 配置方案(推荐)

这里提供一个针对织梦CMS的、比较全面和安全的 robots.txt 配置方案。

通用安全版(适用于所有织梦网站)

这个版本禁止了所有非必要目录,确保了网站的安全和结构不被暴露。

User-agent: * # 禁止访问所有后台、配置、模板、功能目录 Disallow: /dede/ Disallow: /data/ Disallow: /templets/ Disallow: /plus/ Disallow: /include/ Disallow: /install/ # 禁止访问动态页面和专题列表页(可选,但推荐) Disallow: /plus/*.php Disallow: /special/ # 禁止访问特定后缀的文件 Disallow: //*.php Disallow: //*.js Disallow: //*.css # 允许抓取上传目录 Allow: /uploads/ # 专门针对百度爬虫的规则(可选) User-agent: Baiduspider # 百度对sitemap的抓取很友好,可以主动提供sitemap地址 Sitemap: https://www.yourdomain.com/sitemap.xml

使用说明:

- 将

https://www.yourdomain.com替换成你自己的网站域名。 Disallow: /*.php这条规则会禁止所有PHP页面,如果你的网站首页是index.php,并且你希望它被收录,可以将其改为Disallow: /plus/*.php,只禁止plus目录下的PHP文件,并确保你的首页是静态的(.html)。Sitemap是可选的,但强烈推荐,它告诉搜索引擎你网站地图的位置,有助于它们更高效地抓取。

SEO优化版(更精细的控制)

这个版本在安全的基础上,允许部分动态页面被收录,如果你的网站做了很好的伪静态处理,可以考虑这个版本。

User-agent: * # 核心安全目录,必须禁止 Disallow: /dede/ Disallow: /data/ Disallow: /include/ Disallow: /install/ # 模板和功能目录,建议禁止 Disallow: /templets/ Disallow: /plus/ # 禁止专题列表页 Disallow: /special/ # 允许抓取所有静态页面、上传目录和附件 Allow: / Allow: /uploads/ # 针对百度爬虫 User-agent: Baiduspider Sitemap: https://www.yourdomain.com/sitemap.xml

这个版本的逻辑是:

Allow: /允许抓取根目录下的所有文件。Disallow: /plus/禁止了plus目录,plus下的动态页(如plus/list.php)还是不会被访问。- 这种方式更简单,主要依靠织梦生成静态HTML文件,让爬虫直接抓取这些

.html文件。

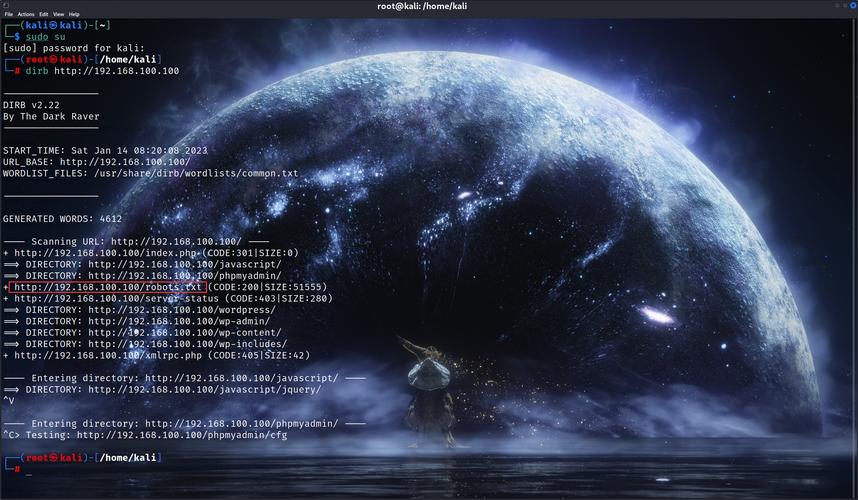

如何将 robots.txt 文件上传到你的网站?

配置好 robots.txt 内容后,你需要将它上传到网站的根目录。

-

创建文件:

- 在你的电脑上,使用记事本(Notepad)、VS Code、Sublime Text 等任何文本编辑器。

- 将上面推荐的代码复制进去。

- 另存为

robots.txt文件。注意: 文件名必须是全小写,没有后缀名(如.txt.txt)。

-

上传文件:

- 通过FTP工具(如 FileZilla)连接到你的服务器。

- 进入网站根目录(通常是

public_html、wwwroot或httpdocs)。 - 将刚刚创建的

robots.txt文件拖拽或上传到这个根目录中。

-

验证:

- 在浏览器中访问

https://www.yourdomain.com/robots.txt。 - 如果能看到你刚才配置的文本内容,说明上传成功。

- 你也可以使用百度搜索资源平台的“robots.txt》检测工具”或Google的“robots.txt测试工具”来验证你的配置是否正确。

- 在浏览器中访问

重要提醒

- 不要禁止

/uploads/目录:图片和视频等内容是网站价值的重要组成部分,禁止它们会影响SEO效果。 - Sitemap 是好帮手:

robots.txt只是告诉爬虫“什么不能看”,而sitemap.xml告诉爬虫“这里有你所有想看的内容的清单”,两者结合使用,效果最佳。 - 动态与静态:织梦通过生成静态HTML来优化SEO,你的

robots.txt配置应该引导爬虫去抓取这些静态的.html文件,而不是动态的.php文件。 - 保持更新:如果你网站的目录结构发生了变化(比如增加了新的功能模块),记得相应地更新你的

robots.txt文件。

希望这份详细的指南能帮助你成功配置织梦网站的 robots.txt 文件!