这个名字通常是用户自定义的,而不是 C 语言标准库的一部分,从名字来看,它极大概率是用于初始化一个卷积神经网络中的卷积层。

(图片来源网络,侵删)

下面我将从几个方面为你详细解释:

- 函数名称解析:它是什么意思?

- 函数的功能和目标:它具体做什么?

- 一个典型的实现代码:它可能长什么样?

- 代码详解:每一行代码是做什么的?

- 如何使用:一个完整的调用示例。

函数名称解析

initcovlayer 是一个典型的驼峰命名法,我们可以把它拆解成三个部分:

- init:

initialize的缩写,意思是“初始化”,这是函数的核心目的。 - cov:

convolution的缩写,意思是“卷积”,这表明函数处理的与卷积操作有关。 - layer: “层”,在神经网络中,层是基本的计算单元。

initcovlayer 的完整含义就是 “初始化卷积层”。

函数的功能和目标

一个卷积层在神经网络中包含了很多参数和状态。initcovlayer 函数的目标就是:

(图片来源网络,侵删)

- 分配内存:为卷积层的所有数据结构(如权重、偏置、输出特征图等)在内存中分配空间。

- 设置超参数:初始化卷积层的配置信息,

- 输入/输出通道数

- 卷积核大小

- 步长

- 填充

- 初始化权重和偏置:这是最关键的一步,将卷积核的权重和偏置设置为一个合适的初始值,常见的初始化方法有:

- 随机初始化:使用正态分布或均匀分布生成小随机数。

- Xavier/Glorot 初始化:一种更智能的随机初始化,考虑了输入和输出神经元的数量,有助于缓解梯度消失或爆炸问题。

- He 初始化:常用于 ReLU 激活函数,是 Xavier 初始化的改进版。

- 清零其他状态:将输出、梯度等状态变量初始化为零,为前向和反向传播做准备。

一个典型的实现代码

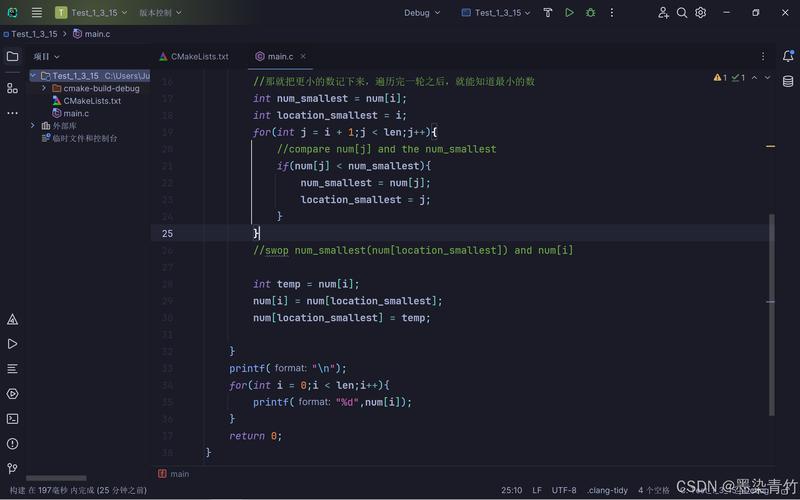

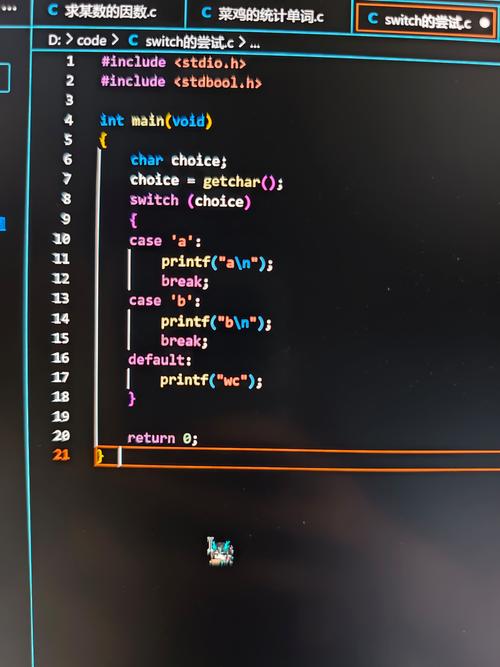

下面是一个用 C 语言实现的 initcovlayer 函数的示例,这个例子结构清晰,包含了注释,可以帮助你理解。

#include <stdio.h>

#include <stdlib.h>

#include <math.h>

#include <time.h>

// 定义一个卷积层的数据结构

typedef struct {

int in_channels; // 输入通道数 (e.g., 3 for RGB image)

int out_channels; // 输出通道数 (e.g., 16)

int kernel_size; // 卷积核大小 (e.g., 3 for 3x3 kernel)

int stride; // 步长 (e.g., 1)

int padding; // 填充 (e.g., 1)

double *weights; // 卷积核权重 [out_channels][in_channels][kernel_size][kernel_size]

double *biases; // 偏置 [out_channels]

double *output; // 输出特征图 [batch_size][out_channels][out_height][out_width]

double *grad_weights; // 权重梯度

double *grad_biases; // 偏置梯度

// ... 其他可能需要的成员变量,如输入、激活值等

} ConvLayer;

/**

* @brief 初始化一个卷积层

*

* @param layer 指向要初始化的卷积层结构体的指针

* @param in_channels 输入通道数

* @param out_channels 输出通道数

* @param kernel_size 卷积核大小

* @param stride 步长

* @param padding 填充

*/

void initcovlayer(ConvLayer *layer, int in_channels, int out_channels, int kernel_size, int stride, int padding) {

// 1. 设置超参数

layer->in_channels = in_channels;

layer->out_channels = out_channels;

layer->kernel_size = kernel_size;

layer->stride = stride;

layer->padding = padding;

// 2. 分配并初始化权重

// 权重总数: out_channels * in_channels * kernel_size * kernel_size

int weights_size = out_channels * in_channels * kernel_size * kernel_size;

layer->weights = (double *)malloc(weights_size * sizeof(double));

if (layer->weights == NULL) {

fprintf(stderr, "Memory allocation failed for weights.\n");

exit(EXIT_FAILURE);

}

// 使用 Xavier/Glorot 初始化方法

// 标准差 = sqrt(2.0 / (fan_in + fan_out))

// fan_in = in_channels * kernel_size * kernel_size

// fan_out = out_channels * kernel_size * kernel_size

// 对于卷积层,一个常见的简化是 sqrt(2.0 / fan_in)

double scale = sqrt(2.0 / (in_channels * kernel_size * kernel_size));

srand(time(NULL)); // 设置随机种子

for (int i = 0; i < weights_size; i++) {

// 从均值为0,标准差为scale的正态分布中采样

// 这里用Box-Muller变换近似生成正态分布随机数

double u1 = (double)rand() / RAND_MAX;

double u2 = (double)rand() / RAND_MAX;

double z0 = sqrt(-2.0 * log(u1)) * cos(2.0 * M_PI * u2);

layer->weights[i] = z0 * scale;

}

// 3. 分配并初始化偏置

// 偏置总数: out_channels

layer->biases = (double *)malloc(out_channels * sizeof(double));

if (layer->biases == NULL) {

fprintf(stderr, "Memory allocation failed for biases.\n");

exit(EXIT_FAILURE);

}

for (int i = 0; i < out_channels; i++) {

layer->biases[i] = 0.0; // 偏置通常初始化为0

}

// 4. 分配内存用于输出和梯度 (注意:这里假设输出尺寸已计算好,实际中可能需要先计算)

// 为了示例简化,我们暂时不在这里分配output,因为它依赖于输入图像的尺寸。

// 实际应用中,你会有一个单独的函数来设置输入尺寸并分配输出内存。

// layer->output = ...;

// layer->grad_weights = ...;

// layer->grad_biases = ...;

printf("Convolution layer initialized successfully.\n");

printf(" - In Channels: %d\n", layer->in_channels);

printf(" - Out Channels: %d\n", layer->out_channels);

printf(" - Kernel Size: %d\n", layer->kernel_size);

printf(" - Weights initialized with Xavier method.\n");

}

// 释放卷积层内存的函数

void free_conv_layer(ConvLayer *layer) {

free(layer->weights);

free(layer->biases);

// free(layer->output);

// ...

printf("Convolution layer memory freed.\n");

}

int main() {

ConvLayer my_conv_layer;

// 初始化一个卷积层: 输入3通道,输出16通道,3x3卷积核,步长1,填充1

initcovlayer(&my_conv_layer, 3, 16, 3, 1, 1);

// 使用完后,记得释放内存

free_conv_layer(&my_conv_layer);

return 0;

}

代码详解

-

ConvLayer结构体:- 这是一个 C 语言中常见的做法,将一个复杂对象的所有相关数据打包在一个结构体里。

- 它包含了定义卷积层所需的所有信息:超参数(

in_channels,out_channels等)、数据(weights,biases)和状态(output)。

-

initcovlayer函数签名:void initcovlayer(ConvLayer *layer, ...): 函数接收一个指向ConvLayer结构体的指针,而不是结构体本身,这是因为在 C 语言中,传递指针可以避免复制整个大结构体,效率更高,并且允许函数直接修改原始结构体的内容。

-

设置超参数:

(图片来源网络,侵删)

(图片来源网络,侵删)layer->in_channels = in_channels;: 使用->操作符通过指针访问结构体的成员,并赋值,这部分很简单,只是存储配置信息。

-

分配和初始化权重:

malloc: 动态内存分配函数,为权重数组分配一块连续的内存空间。- Xavier 初始化: 这是深度学习中的一个关键技巧,如果权重初始化得太大,信号在传播时会爆炸;如果太小,则会消失,Xavier 初始化通过设置一个合理的标准差,使得权重分布在一个合适的范围内,有助于网络稳定训练。

srand(time(NULL)): 初始化随机数生成器,确保每次运行程序时得到的随机数都不同。for循环: 遍历权重数组的每一个元素,并用一个近似正态分布的随机数填充它。

-

分配和初始化偏置:

偏置的初始化通常更简单,直接初始化为 0 即可,因为权重已经可以提供足够的随机性,偏置的作用是微调。

-

内存释放:

free_conv_layer函数展示了与malloc对应的free操作,在使用完动态分配的内存后,必须将其释放,否则会导致内存泄漏。

如何使用 (

使用 initcovlayer 函数的典型流程如下:

- 定义结构体变量:

ConvLayer my_layer; - 调用初始化函数:

initcovlayer(&my_layer, ...);传入所需的参数。 - 使用卷积层: 在训练或推理循环中,使用

my_layer.weights,my_layer.biases等进行前向传播和反向传播计算。 - 释放内存: 当不再需要该卷积层时,调用

free_conv_layer(&my_layer);释放所有动态分配的内存。

这个 initcovlayer 函数是构建一个简单 CNN 库的基础,在更复杂的实现中,你可能还会看到分离的 conv_forward 和 conv_backward 函数来分别处理前向和反向传播的计算。